Zu gefährlich? Neue Claude-KI bleibt geheim

Bild: Gemini KI/Goelden.de

Das neue KI-Modell des OpenAI-Konkurrenten Anthropic hat unter anderem eine 27 Jahre alte Sicherheitslücke in einem weit verbreiteten Betriebssystem entdeckt. Nun wollen weitere Unternehmen von diesen Fähigkeiten profitieren.

Ein aktuelles KI-Modell von Anthropic ist derart effektiv beim Aufspüren bislang unbekannter Schwachstellen in Software, dass es in der Hand Krimineller zu einer äußerst gefährlichen Cyberwaffe werden könnte.

Aus diesem Grund stellt Anthropic das System nicht öffentlich bereit, sondern nutzt es gemeinsam mit Firmen wie Apple, Amazon und Microsoft, um Sicherheitslücken in deren Produkten zu schließen.

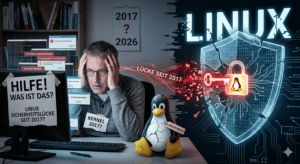

Das Modell mit dem Namen Claude Mythos Preview identifizierte unter anderem eine 27 Jahre alte Schwachstelle im als besonders sicher eingestuften Betriebssystem OpenBSD, wie Anthropic mitteilte.

Insgesamt habe man mit Mythos bereits „tausende“ gravierende Verwundbarkeiten ausfindig gemacht – darunter in jedem gängigen Betriebssystem und Webbrowser. In der Videosoftware FFmpeg entdeckte das System eine seit 16 Jahren bestehende Lücke.

Besorgniserregende Fähigkeiten

Mythos Preview war den Angaben zufolge zudem in der Lage, innerhalb weniger Stunden Programme zu schreiben, mit denen sich diese Schwachstellen ausnutzen lassen – Aufgaben, für die Fachleute nach eigenen Aussagen sonst mehrere Wochen benötigen würden.

Frühe Versionen der Software erhielten in einem Experiment den Auftrag, aus einer isolierten Computerumgebung auszubrechen und den Tester darüber zu informieren. Laut Anthropic gelang es dem System, Schutzmechanismen zu umgehen, sich erweiterten Zugang zum Internet zu verschaffen und dem Mitarbeiter eine unerwartete E-Mail zu senden, während dieser mit einem Sandwich im Park saß.

Quelle: Chip.de

Die andere Seite

Die andere Seite